GPT 不是适⽤于某⼀⻔语⾔的⼤型语⾔模型,它适⽤于⼏乎所有流⾏的⾃然语⾔。为了能够掌握这么多语⾔,GPT将所有⼈类的语⾔⽂字分解为tokens(中⽂译名:令牌或者词元,个⼈感觉词元更加诗意)。

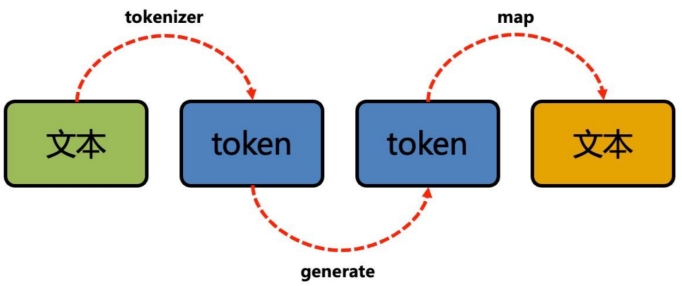

Token 就是⾃然语⾔处理的最细粒度。简单点说就是,GPT 的输⼊是⼀个个的 Token,输出也是⼀个个的 Token。tokens可以被认为是单词⽚段。这些tokens并不是在单词开始或结束的地⽅被分割的――tokens可以包括尾随空格甚⾄⼦单词。GPT 的背后原理是将我们输⼊的⽂字转换成 token,然后通过 GPT 模型预测 token,再将 token 转换成⽂字,最后再输出给我们。

以下是⼀些有⽤的经验法则,可⽤于了解tokens的⻓度:

1 token ~= 4 chars in English

1 token ~= ¾ words

100 tokens ~= 75 words

或者

1-2 sentence ~= 30 tokens

1 paragraph ~= 100 tokens

1,500 words ~= 2048 tokens

1K tokens对应⼤约是250-300个汉字,600-700个英⽂单词(⼤概统计,不包含中间损耗等随机因素)⼈类⽂字的复杂程度越⾼,所消耗的tokens越⼤。

打赏

收藏

点赞

最后修改时间:

秘塔AI搜索是一款基于大模型的新一代智能搜索引擎

上一篇

2024年03月09日 17:31

直接免费使用Claude 3,无需魔法无需注册!(Claude 3的正确打开方式)

下一篇

2024年03月10日 21:14

相关文章

发表评论

评论列表